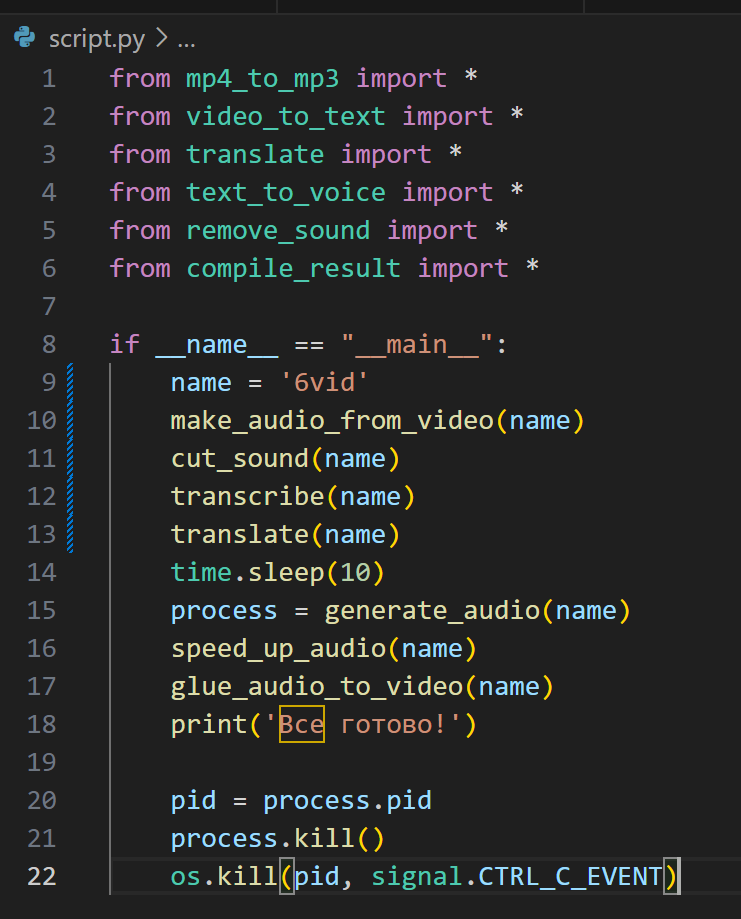

пожалуйста проверьте, оцените, обосрите, похвалите, скажите что можно сделать лучше, что и так хорошо.

еееесть такое, но было впадлу писать каждую функцию отдельно

так разве тяночий голос не превратит нормальное прослушивание аниме в несерьезный сюр? По такой логике мужской голос выбрал, сейчас узнаем что там с женщинами

Здесь мы делимся рецептами запуска, настроек и годных промтов, расширяем сознание контекст, и бугуртим с кривейшего тормозного говна.

Тред для обладателей топовых карт NVidia с кучей VRAM или мажоров с проф картами уровня A100, или любителей подождать, если есть оперативная память. Особо терпеливые могут использовать даже подкачку и запускать модели, квантованные до 8 5 4 3 2 0,58 бит, на кофеварке с подкачкой на микроволновку.

Здесь и далее расположена базовая информация, полная инфа и гайды в вики https://2ch-ai.gitgud.site/wiki/llama/

LLaMA 3 вышла! Увы, только в размерах 8B и 70B. Промты уже вшиты в новую таверну, ждём исправлений по части квантования от жоры, наверняка он подгадил.

Базовой единицей обработки любой языковой модели является токен. Токен это минимальная единица, на которые разбивается текст перед подачей его в модель, обычно это слово (если популярное), часть слова, в худшем случае это буква (а то и вовсе байт).

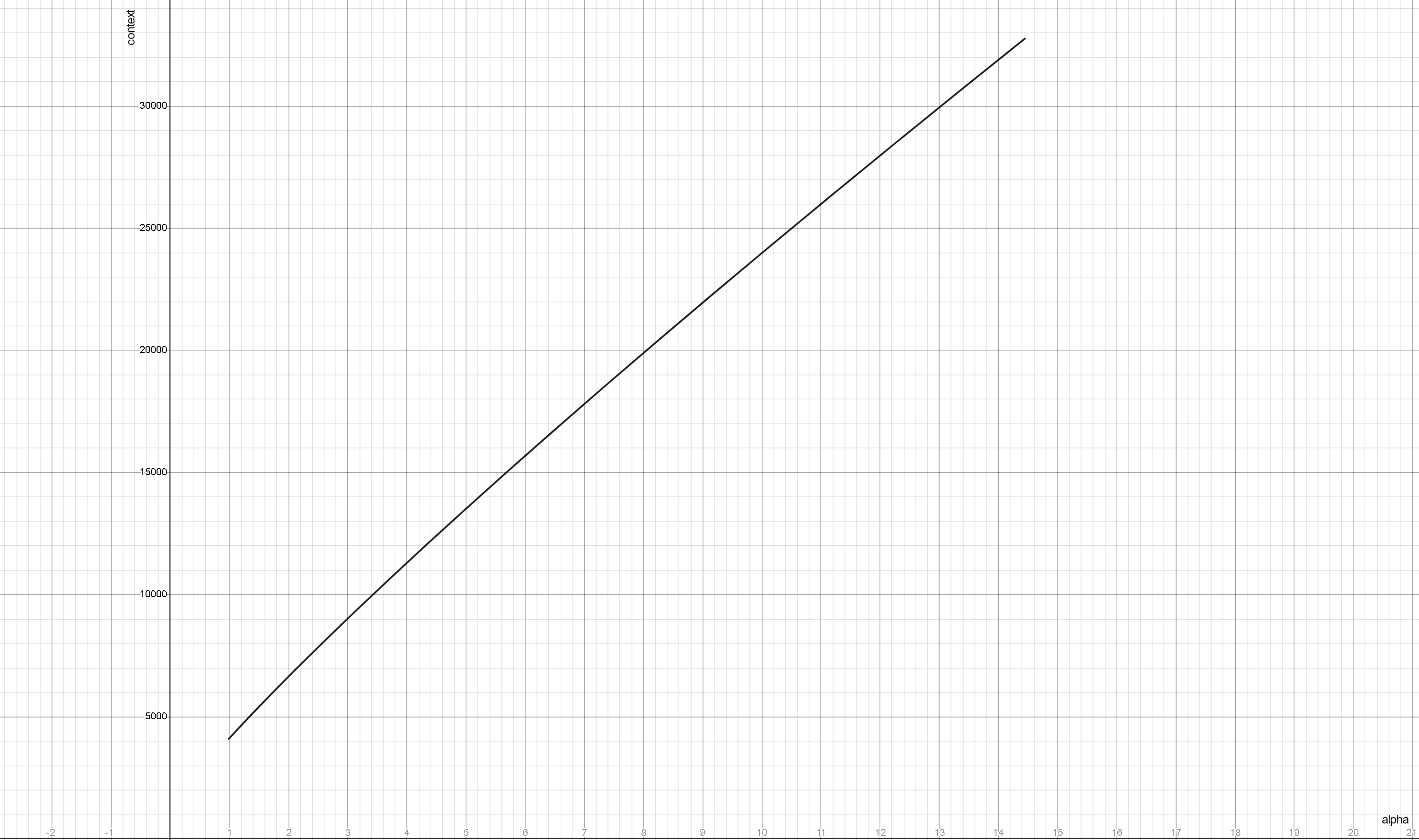

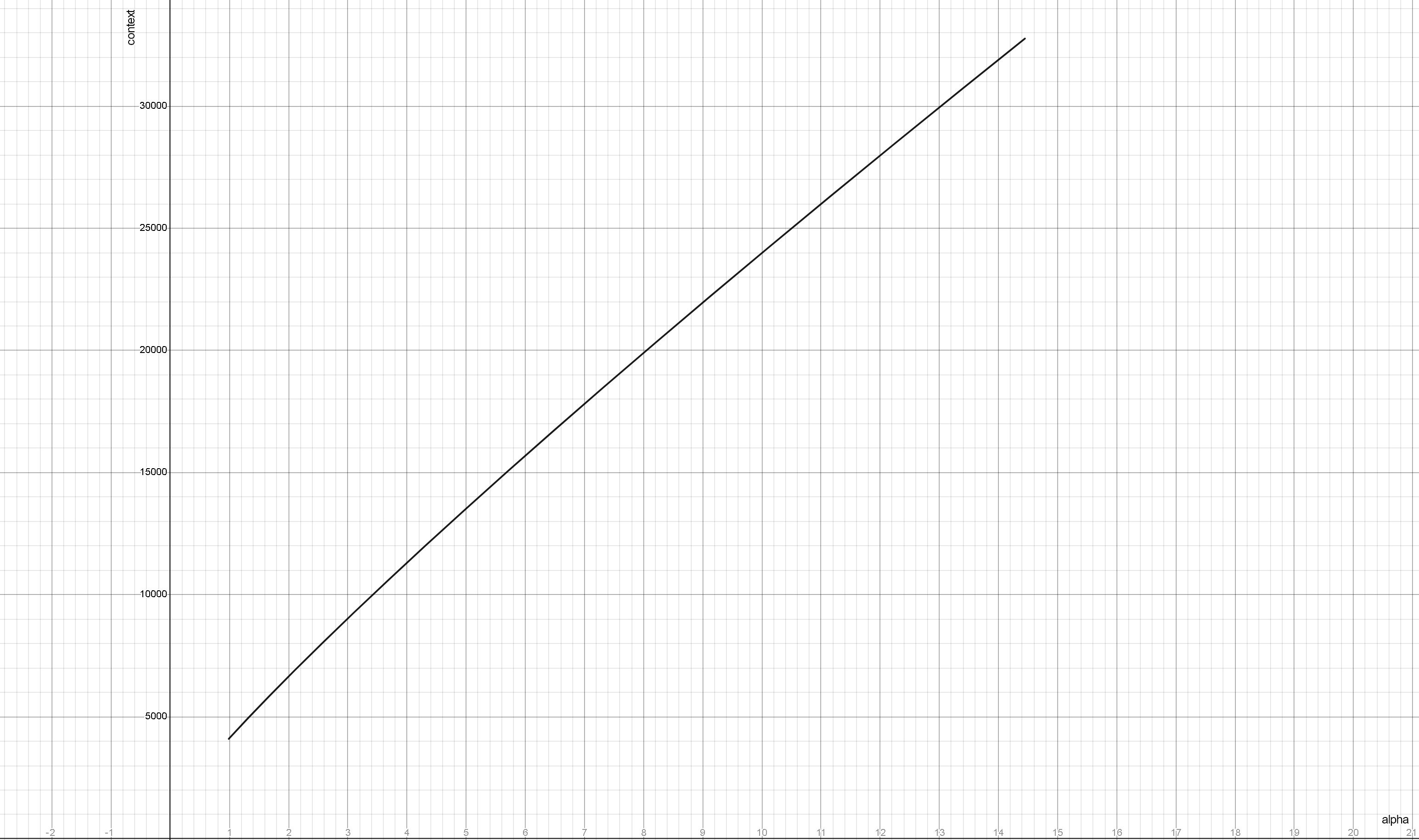

Из последовательности токенов строится контекст модели. Контекст это всё, что подаётся на вход, плюс резервирование для выхода. Типичным максимальным размером контекста сейчас являются 2к (2 тысячи) и 4к токенов, но есть и исключения. В этот объём нужно уместить описание персонажа, мира, истории чата. Для расширения контекста сейчас применяется метод NTK-Aware Scaled RoPE. Родной размер контекста для Llama 1 составляет 2к токенов, для Llama 2 это 4к, Llama 3 обладает базовым контекстом в 8к, но при помощи RoPE этот контекст увеличивается в 2-4-8 раз без существенной потери качества.

Базовым языком для языковых моделей является английский. Он в приоритете для общения, на нём проводятся все тесты и оценки качества. Большинство моделей хорошо понимают русский на входе т.к. в их датасетах присутствуют разные языки, в том числе и русский. Но их ответы на других языках будут низкого качества и могут содержать ошибки из-за несбалансированности датасета. Существуют мультиязычные модели частично или полностью лишенные этого недостатка, из легковесных это openchat-3.5-0106, который может давать качественные ответы на русском и рекомендуется для этого. Из тяжёлых это Command-R. Файнтюны семейства "Сайга" не рекомендуются в виду их низкого качества и ошибок при обучении.

Основным представителем локальных моделей является LLaMA. LLaMA это генеративные текстовые модели размерами от 7B до 70B, притом младшие версии моделей превосходят во многих тестах GTP3 (по утверждению самого фейсбука), в которой 175B параметров. Сейчас на нее существует множество файнтюнов, например Vicuna/Stable Beluga/Airoboros/WizardLM/Chronos/(любые другие) как под выполнение инструкций в стиле ChatGPT, так и под РП/сторитейл. Для получения хорошего результата нужно использовать подходящий формат промта, иначе на выходе будут мусорные теги. Некоторые модели могут быть излишне соевыми, включая Chat версии оригинальной Llama 2.

Про остальные семейства моделей читайте в вики.

Основные форматы хранения весов это GGML и GPTQ, остальные нейрокуну не нужны. Оптимальным по соотношению размер/качество является 5 бит, по размеру брать максимальную, что помещается в память (видео или оперативную), для быстрого прикидывания расхода можно взять размер модели и прибавить по гигабайту за каждые 1к контекста, то есть для 7B модели GGML весом в 4.7ГБ и контекста в 2к нужно ~7ГБ оперативной.

В общем и целом для 7B хватает видеокарт с 8ГБ, для 13B нужно минимум 12ГБ, для 30B потребуется 24ГБ, а с 65-70B не справится ни одна бытовая карта в одиночку, нужно 2 по 3090/4090.

Даже если использовать сборки для процессоров, то всё равно лучше попробовать задействовать видеокарту, хотя бы для обработки промта (Use CuBLAS или ClBLAS в настройках пресетов кобольда), а если осталась свободная VRAM, то можно выгрузить несколько слоёв нейронной сети на видеокарту. Число слоёв для выгрузки нужно подбирать индивидуально, в зависимости от объёма свободной памяти. Смотри не переборщи, Анон! Если выгрузить слишком много, то начиная с 535 версии драйвера NVidia это может серьёзно замедлить работу, если не выключить CUDA System Fallback в настройках панели NVidia. Лучше оставить запас.

Гайд для ретардов для запуска LLaMA без излишней ебли под Windows. Грузит всё в процессор, поэтому ёба карта не нужна, запаситесь оперативкой и подкачкой:

1. Скачиваем koboldcpp.exe https://github.com/LostRuins/koboldcpp/releases/ последней версии.

2. Скачиваем модель в gguf формате. Например вот эту:

https://huggingface.co/Sao10K/Fimbulvetr-10.7B-v1-GGUF/blob/main/Fimbulvetr-10.7B-v1.q5_K_M.gguf

Можно просто вбить в huggingace в поиске "gguf" и скачать любую, охуеть, да? Главное, скачай файл с расширением .gguf, а не какой-нибудь .pt

3. Запускаем koboldcpp.exe и выбираем скачанную модель.

4. Заходим в браузере на http://localhost:5001/

5. Все, общаемся с ИИ, читаем охуительные истории или отправляемся в Adventure.

Да, просто запускаем, выбираем файл и открываем адрес в браузере, даже ваша бабка разберется!

Для удобства можно использовать интерфейс TavernAI

1. Ставим по инструкции, пока не запустится: https://github.com/Cohee1207/SillyTavern

2. Запускаем всё добро

3. Ставим в настройках KoboldAI везде, и адрес сервера http://127.0.0.1:5001

4. Активируем Instruct Mode и выставляем в настройках пресетов Alpaca

5. Радуемся

Инструменты для запуска:

https://github.com/LostRuins/koboldcpp/ Репозиторий с реализацией на плюсах

https://github.com/oobabooga/text-generation-webui/ ВебуУИ в стиле Stable Diffusion, поддерживает кучу бекендов и фронтендов, в том числе может связать фронтенд в виде Таверны и бекенды ExLlama/llama.cpp/AutoGPTQ

https://github.com/ollama/ollama Однокнопочный инструмент для полных хлебушков в псевдо стиле Apple (никаких настроек, автор знает лучше)

Ссылки на модели и гайды:

https://huggingface.co/models Модели искать тут, вбиваем название + тип квантования

https://rentry.co/TESFT-LLaMa Не самые свежие гайды на ангельском

https://rentry.co/STAI-Termux Запуск SillyTavern на телефоне

https://rentry.co/lmg_models Самый полный список годных моделей

http://ayumi.m8geil.de/ayumi_bench_v3_results.html Рейтинг моделей для кума со спорной методикой тестирования

https://rentry.co/llm-training Гайд по обучению своей лоры

https://rentry.co/2ch-pygma-thread Шапка треда PygmalionAI, можно найти много интересного

https://colab.research.google.com/drive/11U-bC6AxdmMhd3PF9vWZpLdi6LdfnBQ8?usp=sharing Последний известный колаб для обладателей отсутствия любых возможностей запустить локально

Шапка в https://rentry.co/llama-2ch, предложения принимаются в треде

Предыдущие треды тонут здесь:

>>714898 (OP)

>>712072 (OP)

https://2ch.hk/api/archive/search

Тут LLaMA введи, часть старых тредов в архиве двача сохранена.

https://2ch.hk/ai/arch/

Ссылка не та.

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

Общий вопросов по чат-ботам и прочего тред.

- Фронтэнды -

Agnai, SillyTavern, RisuAI

Гайды: https://rentry.co/ultimatespoonfeed | https://rentry.co/Tavern4Retards (Гайд на английском) | https://rentry.org/STAI-Termux (На андроид)

Базовые термины: https://2ch-ai.gitgud.site/wiki/llama/

Скрипты SillyTavern (Quick Replies): https://rentry.org/stscript

https://github.com/SillyTavern/SillyTavern | https://github.com/ntvm/SillyTavern (Форк нв-куна)

https://agnai.chat/

https://risuai.xyz/

- GPT -

Джейлы на 0314/0613: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/fa5fv | https://dumb.one/gpt/prompts-scraped/ | https://rentry.co/lobstersgpt

Джейлы на 1106: https://rentry.co/anonaugusproductionsCustomJB | https://rentry.co/crustcrunchGPT | https://rentry.co/Myuu_Jippy | https://rentry.co/CoTonAugus | https://rentry.org/onichan2210

Джейлы на 0125: https://rentry.org/neo-furbo | https://rentry.org/camicle-jb

Джейлы на Turbo: https://rentry.co/YAnonTurbo | https://rentry.co/hochi-reupload

- Claude -

Джейлы: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/absolutejail | https://rentry.co/pitanonbots#prompt-presets | https://rentry.co/XML-dva-shiza | https://rentry.co/crustcrunchJB | https://rentry.co/CharacterProvider | https://rentry.co/MyuuTastic

Опус/Соннет: https://rentry.org/Anon4Anon | https://unconvincing.neocities.org/ | https://rentry.org/pancatb3ta | https://rentry.org/AiBrainPresets | https://rentry.org/CladeOpus-GigaSchizoKostyl

Удаление Human/Assistant: https://rentry.co/TavernNoAss | https://rentry.co/HumAssistOff

Префилл: https://rentry.co/aui3u

Полезное: https://rentry.org/anonika_infoblock | https://rentry.org/zapominator

- Мемо -

Мемо вручную: https://rentry.co/DrunkArcadeExample

Генератор мемо: https://rentry.co/LazyMemo

Мемо на опусе: https://rentry.co/HornyPigs

- Bing -

https://github.com/Barbariskaa/Biba

Гайд: https://rentry.co/BingZOVEdition

- Локалки -

https://openrouter.ai/

Гайд (на английском): https://rentry.co/meta_golocal_list

- Ботоводчество -

https://www.chub.ai

https://booru.plus/+pygmalion

https://des une.moe/aichared/

https://agnai.chat/editor

https://rentry.co/botmaking_tips

https://rentry.co/MothsBotMakingStuff

https://rentry.co/oaicards

Боты анонов: https://rentry.co/2chaicgtavernbots | https://rentry.co/2chaicgtavernbots2

- Село 2ch -

https://rentry.co/selo2ch

- Архив тредов -

https://rentry.co/2ch-aicg-archives

- GIGACHAT -

https://rentry.co/3bc7r

- Character.AI -

https://beta.character.ai/

https://rentry.co/CAI-FAQ

Боты анонов: https://rentry.co/CAI-bots

- Прочее -

Проверить ключ:

GPT

https://github.com/Buhankoanon/OAI_API_Checker | https://github.com/CncAnon1/kkc

Claude

https://github.com/Definetelynotbranon/Anthropic_API_Checker

Специфические промпты в джейл для кума: https://rentry.co/jinxbreaks

Забавные промпты после кума: https://rentry.co/weirdbutfunjailbreaksandprompts

- Конкурсы -

Общая информация: https://rentry.co/2chaicgthemedevents

Текущий конкурс: >>718019 →

- Шапка -

https://rentry.co/shapkacaitreda

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

- Локальные языковые модели: >>661076 (OP) -

- Прошлый тред: >>717384 (OP)

https://www.chub.ai/characters/Hana_X_Hina/asakura-family-c427bbd2b3b1/main

======================================

Предыдущий тред >>708081 (OP) https://arhivac.top/?tags=13840

------------------------------------------

схожие тематические треды

- NAI-тред (аниме) >>708540 (OP)

- технотред >>639060 (OP)

========================

Stable Diffusion (SD) - открытая нейросеть генеративного искусства для создания картинок из текста/исходных картинок, обучения на своих изображениях.

Полный функционал в локальной установке (см. ниже)

Альтернативный онлайн-генератор №1: https://dezgo.com/txt2img

Альтернативный онлайн-генератор №2: https://civitai.com/ (create после регистрации)

Альтернативный онлайн-генератор №3: https://tensor.art/ (Workspace)

⚠️ Стандартные модели stable diffusion от Stability AI значительно отстают по качеству от кастомных моделей (см. civitai ниже).

🔞 Без цензуры и полный функци_анал: только ПК-версия

===========================================

🖥УСТАНОВКА НА ПК

WebUI от Automatic1111

https://teletype.in/@stablediffusion/PC_install_SD

------------------------------------------

Forge - Почти тот же WebUI, что и выше, но более быстрый по скорости

https://github.com/lllyasviel/stable-diffusion-webui-forge

------------------------------------------

👉 Для новичков - простой в работе WebUI Fooocus

https://github.com/lllyasviel/Fooocus?tab=readme-ov-file#download

------------------------------------------

Портативная версия альтернативного WebUI от Comfy (запуск с одного из run.bat файлов)

https://github.com/comfyanonymous/ComfyUI/releases

Примерные workflow для ComfyUI (можно загружать напрямую из картинок)

https://comfyanonymous.github.io/ComfyUI_examples/

===========================================

📚 РАЗЛИЧНЫЕ МОДЕЛИ (И МНОГОЕ ДРУГОЕ) 👇

https://civitai.com/

------------------------------------------

📊 ПАРАМЕТРЫ И НАСТРОЙКИ ГЕНЕРАЦИИ 👇

https://teletype.in/@stablediffusion/samplers_steps

===========================================

🎨 ГАЙД ПО СОСТАВЛЕНИЮ ЗАПРОСА, СТИЛИ

https://teletype.in/@stablediffusion/artists_for_prompts

Пример запроса (Промпт): a tiger, wildlife photography, high quality, wildlife, soft focus, 8k, national geographic, photograph by nick nichols

------------------------------------------

♾️РАЗЛИЧНЫЕ ХУДОЖЕСТВЕННЫЕ СТИЛИ (С ПРИМЕРАМИ) 👇

https://supagruen.github.io/StableDiffusion-CheatSheet/

https://www.artvy.ai/styles

------------------------------------------

💻ЧТО ТАКОЕ CONTROLNET И КАК ЕГО ИСПОЛЬЗОВАТЬ

https://www.itshneg.com/controlnt-upravlyaj-pozami-v-stable-diffusion/

==========================================

🧠 ОБУЧЕНИЕ ПО СВОИМ КАРТИНКАМ 👇

https://dtf.ru/howto/1660668-obuchenie-modeli-s-pomoshchyu-lora

https://civitai.com/models/train

> пик2

Душа.

>>720590 (OP)

>>720590 (OP)

>>720590 (OP)

https://youtu.be/Naw3PAUZVZ0

пока всё в зачаточном состоянии

Прошлый >>698708 (OP) https://arhivach.top/thread/1007187/

Схожие тематические треды:

— Технотред >>639060 (OP)

— SD-тред (фотореализм) >>708081 (OP)

— Тред в /fur/ https://2ch.hk/fur/res/284014.html

Генерируя в коллабе на чужом блокноте будьте готовы к тому, что его автору могут отправляться все ваши промты, генерации, данные google-аккаунта, IP-адрес и фингерпринт браузера.

F.A.Q. треда: https://rentry.co/nai_faq

Устанавливаем на ПК/Облако: https://rentry.co/nai_faq#как-поставить-на-пкоблако

Полезные расширения для WebUI: https://rentry.co/sd_automatic_extensions

➤ Гайды

Гайды по промптам, списки тегов и негативных эмбеддингов: https://rentry.co/nai_faq#как-писать-промпты

ControlNet для начинающих: https://www.itshneg.com/controlnet-upravlyaj-pozami-v-stable-diffusion

Полная инфа по ControlNet: https://stable-diffusion-art.com/controlnet

Апскейл для начинающих: https://rentry.co/sd__upscale | https://rentry.co/SD_upscale | https://rentry.co/2ch_nai_guide#апскейл

Апскейл с помощью ControlNet (для продвинутых, требуется минимум 8GB VRAM): https://rentry.co/UpscaleByControl

Гайды по обучению лор: https://rentry.co/waavd | https://rentry.co/2chAI_hard_LoRA_guide

➤ Интерфейсы для Stable Diffusion

Stable Diffusion WebUI by AUTOMATIC1111

https://github.com/AUTOMATIC1111/stable-diffusion-webui

Классический WebUI от AUTOMATIC1111. Самое большое число пользователей и наработок.

Оптимизации для слабых ПК (6GB VRAM и менее): https://rentry.co/voldy#-running-on-4gb-and-under-

Общие советы по оптимизациям: https://github.com/AUTOMATIC1111/stable-diffusion-webui/wiki/Optimizations

ComfyUI

https://github.com/comfyanonymous/ComfyUI

Интерфейс, заточенный на построение собственных workflow посредством организации конвееров через редактирование нод с различными действиями и указанием связей между ними.

Англоязычный гайд от автора в виде визуальный новеллы: https://comfyanonymous.github.io/ComfyUI_tutorial_vn/

Примеры готовых workflow: https://comfyanonymous.github.io/ComfyUI_examples/

Русскоязычный гайд: https://habr.com/ru/articles/729848/

WebUI Forge

https://github.com/lllyasviel/stable-diffusion-webui-forge

WebUI от автора контролнета. По интерфейсу аналогичен WebUI от автоматика, но более быстрый.

Foocus

https://github.com/lllyasviel/Fooocus

Альтернативный WebUI от автора контролнета, ориентированный на простоту использования.

Доступен в облаке гугла (колаб): https://colab.research.google.com/github/lllyasviel/Fooocus/blob/main/fooocus_colab.ipynb

➤ Каталог популярных моделей

Чекпоинты SD 1.5: https://civitai.com/collections/42742

Чекпоинты SD XL: https://civitai.com/collections/42753

Генерация аниме на EasyFluff + hll-ликорисе: https://rentry.org/5exa3

Каталог лор на стилизацию для SD 1.5: https://civitai.com/collections/42751

Лоры с форча для SD 1.5: https://gitgud.io/badhands/makesomefuckingporn

Лоры и примечания для PonyDiffusion: https://rentry.org/ponyxl_loras_n_stuff

➤ Дополнительная инфа

Где искать модели, эмбединги, лоры, вайлдкарды и всё остальное: https://civitai.com | https://huggingface.co/models?other=stable-diffusion

АИ-галереи: https://aibooru.online | https://majinai.art

Англоязычные каталоги ссылок: https://stable-diffusion-art.com/tutorials | https://rentry.co/sdg-link | https://rentry.co/sdgoldmine

Шаблон для переката: https://rentry.co/nwhci

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

Общий вопросов по чат-ботам и прочего тред.

- Фронтэнды -

Agnai, SillyTavern, RisuAI

Гайды: https://rentry.co/ultimatespoonfeed | https://rentry.co/Tavern4Retards (Гайд на английском) | https://rentry.org/STAI-Termux (На андроид)

Базовые термины: https://2ch-ai.gitgud.site/wiki/llama/

Скрипты SillyTavern (Quick Replies): https://rentry.org/stscript

https://github.com/SillyTavern/SillyTavern | https://github.com/ntvm/SillyTavern (Форк нв-куна)

https://agnai.chat/

https://risuai.xyz/

- GPT -

Джейлы на 0314/0613: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/fa5fv | https://dumb.one/gpt/prompts-scraped/ | https://rentry.co/lobstersgpt

Джейлы на 1106: https://rentry.co/anonaugusproductionsCustomJB | https://rentry.co/crustcrunchGPT | https://rentry.co/Myuu_Jippy | https://rentry.co/CoTonAugus | https://rentry.org/onichan2210

Джейлы на 0125: https://rentry.org/neo-furbo | https://rentry.org/camicle-jb

Джейлы на Turbo: https://rentry.co/YAnonTurbo | https://rentry.co/hochi-reupload

- Claude -

Джейлы: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/absolutejail | https://rentry.co/pitanonbots#prompt-presets | https://rentry.co/XML-dva-shiza | https://rentry.co/crustcrunchJB | https://rentry.co/CharacterProvider | https://rentry.co/MyuuTastic

Опус/Соннет: https://rentry.org/Anon4Anon | https://unconvincing.neocities.org/ | https://rentry.org/pancatb3ta | https://rentry.org/AiBrainPresets | https://rentry.org/CladeOpus-GigaSchizoKostyl

Удаление Human/Assistant: https://rentry.co/TavernNoAss | https://rentry.co/HumAssistOff

Префилл: https://rentry.co/aui3u

Полезное: https://rentry.org/anonika_infoblock | https://rentry.org/zapominator

- Мемо -

Мемо вручную: https://rentry.co/DrunkArcadeExample

Генератор мемо: https://rentry.co/LazyMemo

Мемо на опусе: https://rentry.co/HornyPigs

- Bing -

https://github.com/Barbariskaa/Biba

Гайд: https://rentry.co/BingZOVEdition

- Локалки -

https://openrouter.ai/

Гайд (на английском): https://rentry.co/meta_golocal_list

- Ботоводчество -

https://www.chub.ai

https://booru.plus/+pygmalion

https://des une.moe/aichared/

https://agnai.chat/editor

https://rentry.co/botmaking_tips

https://rentry.co/MothsBotMakingStuff

https://rentry.co/oaicards

Боты анонов: https://rentry.co/2chaicgtavernbots | https://rentry.co/2chaicgtavernbots2

- Село 2ch -

https://rentry.co/selo2ch

- Архив тредов -

https://rentry.co/2ch-aicg-archives

- GIGACHAT -

https://rentry.co/3bc7r

- Character.AI -

https://beta.character.ai/

https://rentry.co/CAI-FAQ

Боты анонов: https://rentry.co/CAI-bots

- Прочее -

Проверить ключ:

GPT

https://github.com/Buhankoanon/OAI_API_Checker | https://github.com/CncAnon1/kkc

Claude

https://github.com/Definetelynotbranon/Anthropic_API_Checker

Специфические промпты в джейл для кума: https://rentry.co/jinxbreaks

Забавные промпты после кума: https://rentry.co/weirdbutfunjailbreaksandprompts

- Конкурсы -

Общая информация: https://rentry.co/2chaicgthemedevents

Текущий конкурс: >>713069 →

- Шапка -

https://rentry.co/shapkacaitreda

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

- Локальные языковые модели: >>714898 (OP) -

- Прошлый тред: >>714835 (OP) -

Здесь мы делимся рецептами запуска, настроек и годных промтов, расширяем сознание контекст, и бугуртим с кривейшего тормозного говна.

Тред для обладателей топовых карт NVidia с кучей VRAM или мажоров с проф картами уровня A100, или любителей подождать, если есть оперативная память. Особо терпеливые могут использовать даже подкачку и запускать модели, квантованные до 8 5 4 3 2 0,58 бит, на кофеварке с подкачкой на микроволновку.

Здесь и далее расположена базовая информация, полная инфа и гайды в вики https://2ch-ai.gitgud.site/wiki/llama/

LLaMA 3 вышла! Увы, только в размерах 8B и 70B. В треде можно поискать ссылки на правленные промт форматы, дефолтные не подходят. Ждём исправлений.

Базовой единицей обработки любой языковой модели является токен. Токен это минимальная единица, на которые разбивается текст перед подачей его в модель, обычно это слово (если популярное), часть слова, в худшем случае это буква (а то и вовсе байт).

Из последовательности токенов строится контекст модели. Контекст это всё, что подаётся на вход, плюс резервирование для выхода. Типичным максимальным размером контекста сейчас являются 2к (2 тысячи) и 4к токенов, но есть и исключения. В этот объём нужно уместить описание персонажа, мира, истории чата. Для расширения контекста сейчас применяется метод NTK-Aware Scaled RoPE. Родной размер контекста для Llama 1 составляет 2к токенов, для Llama 2 это 4к, Llama 3 обладает базовым контекстом в 8к, но при помощи RoPE этот контекст увеличивается в 2-4-8 раз без существенной потери качества.

Базовым языком для языковых моделей является английский. Он в приоритете для общения, на нём проводятся все тесты и оценки качества. Большинство моделей хорошо понимают русский на входе т.к. в их датасетах присутствуют разные языки, в том числе и русский. Но их ответы на других языках будут низкого качества и могут содержать ошибки из-за несбалансированности датасета. Существуют мультиязычные модели частично или полностью лишенные этого недостатка, из легковесных это openchat-3.5-0106, который может давать качественные ответы на русском и рекомендуется для этого. Из тяжёлых это Command-R. Файнтюны семейства "Сайга" не рекомендуются в виду их низкого качества и ошибок при обучении.

Основным представителем локальных моделей является LLaMA. LLaMA это генеративные текстовые модели размерами от 7B до 70B, притом младшие версии моделей превосходят во многих тестах GTP3 (по утверждению самого фейсбука), в которой 175B параметров. Сейчас на нее существует множество файнтюнов, например Vicuna/Stable Beluga/Airoboros/WizardLM/Chronos/(любые другие) как под выполнение инструкций в стиле ChatGPT, так и под РП/сторитейл. Для получения хорошего результата нужно использовать подходящий формат промта, иначе на выходе будут мусорные теги. Некоторые модели могут быть излишне соевыми, включая Chat версии оригинальной Llama 2.

Про остальные семейства моделей читайте в вики.

Основные форматы хранения весов это GGML и GPTQ, остальные нейрокуну не нужны. Оптимальным по соотношению размер/качество является 5 бит, по размеру брать максимальную, что помещается в память (видео или оперативную), для быстрого прикидывания расхода можно взять размер модели и прибавить по гигабайту за каждые 1к контекста, то есть для 7B модели GGML весом в 4.7ГБ и контекста в 2к нужно ~7ГБ оперативной.

В общем и целом для 7B хватает видеокарт с 8ГБ, для 13B нужно минимум 12ГБ, для 30B потребуется 24ГБ, а с 65-70B не справится ни одна бытовая карта в одиночку, нужно 2 по 3090/4090.

Даже если использовать сборки для процессоров, то всё равно лучше попробовать задействовать видеокарту, хотя бы для обработки промта (Use CuBLAS или ClBLAS в настройках пресетов кобольда), а если осталась свободная VRAM, то можно выгрузить несколько слоёв нейронной сети на видеокарту. Число слоёв для выгрузки нужно подбирать индивидуально, в зависимости от объёма свободной памяти. Смотри не переборщи, Анон! Если выгрузить слишком много, то начиная с 535 версии драйвера NVidia это может серьёзно замедлить работу, если не выключить CUDA System Fallback в настройках панели NVidia. Лучше оставить запас.

Гайд для ретардов для запуска LLaMA без излишней ебли под Windows. Грузит всё в процессор, поэтому ёба карта не нужна, запаситесь оперативкой и подкачкой:

1. Скачиваем koboldcpp.exe https://github.com/LostRuins/koboldcpp/releases/ последней версии.

2. Скачиваем модель в gguf формате. Например вот эту:

https://huggingface.co/Sao10K/Fimbulvetr-10.7B-v1-GGUF/blob/main/Fimbulvetr-10.7B-v1.q5_K_M.gguf

Можно просто вбить в huggingace в поиске "gguf" и скачать любую, охуеть, да? Главное, скачай файл с расширением .gguf, а не какой-нибудь .pt

3. Запускаем koboldcpp.exe и выбираем скачанную модель.

4. Заходим в браузере на http://localhost:5001/

5. Все, общаемся с ИИ, читаем охуительные истории или отправляемся в Adventure.

Да, просто запускаем, выбираем файл и открываем адрес в браузере, даже ваша бабка разберется!

Для удобства можно использовать интерфейс TavernAI

1. Ставим по инструкции, пока не запустится: https://github.com/Cohee1207/SillyTavern

2. Запускаем всё добро

3. Ставим в настройках KoboldAI везде, и адрес сервера http://127.0.0.1:5001

4. Активируем Instruct Mode и выставляем в настройках пресетов Alpaca

5. Радуемся

Инструменты для запуска:

https://github.com/LostRuins/koboldcpp/ Репозиторий с реализацией на плюсах

https://github.com/oobabooga/text-generation-webui/ ВебуУИ в стиле Stable Diffusion, поддерживает кучу бекендов и фронтендов, в том числе может связать фронтенд в виде Таверны и бекенды ExLlama/llama.cpp/AutoGPTQ

https://github.com/ollama/ollama Однокнопочный инструмент для полных хлебушков в псевдо стиле Apple (никаких настроек, автор знает лучше)

Ссылки на модели и гайды:

https://huggingface.co/models Модели искать тут, вбиваем название + тип квантования

https://rentry.co/TESFT-LLaMa Не самые свежие гайды на ангельском

https://rentry.co/STAI-Termux Запуск SillyTavern на телефоне

https://rentry.co/lmg_models Самый полный список годных моделей

http://ayumi.m8geil.de/ayumi_bench_v3_results.html Рейтинг моделей для кума со спорной методикой тестирования

https://rentry.co/llm-training Гайд по обучению своей лоры

https://rentry.co/2ch-pygma-thread Шапка треда PygmalionAI, можно найти много интересного

https://colab.research.google.com/drive/11U-bC6AxdmMhd3PF9vWZpLdi6LdfnBQ8?usp=sharing Последний известный колаб для обладателей отсутствия любых возможностей запустить локально

Шапка в https://rentry.co/llama-2ch, предложения принимаются в треде

Предыдущие треды тонут здесь:

>>712072 (OP)

>>709757 (OP)

ПЕРЕКАТ

>>717999 (OP)

ПЕРЕКАТ

>>717999 (OP)

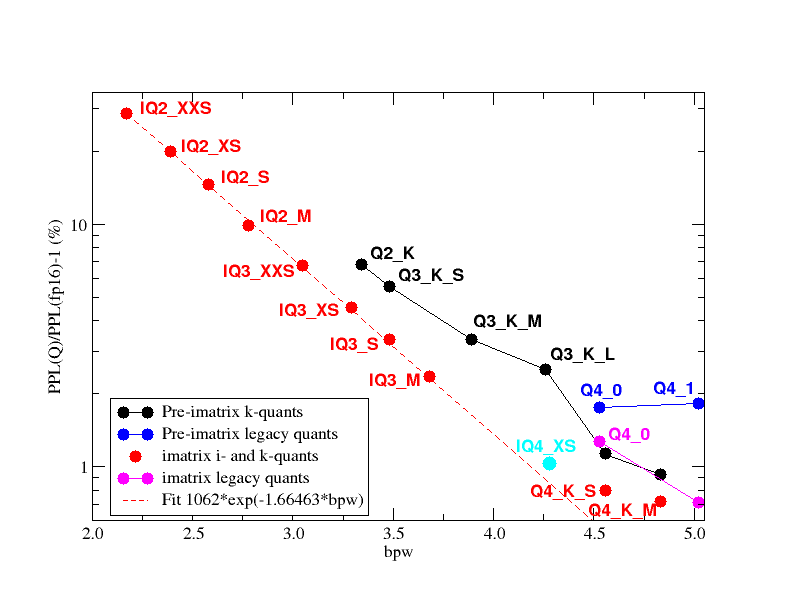

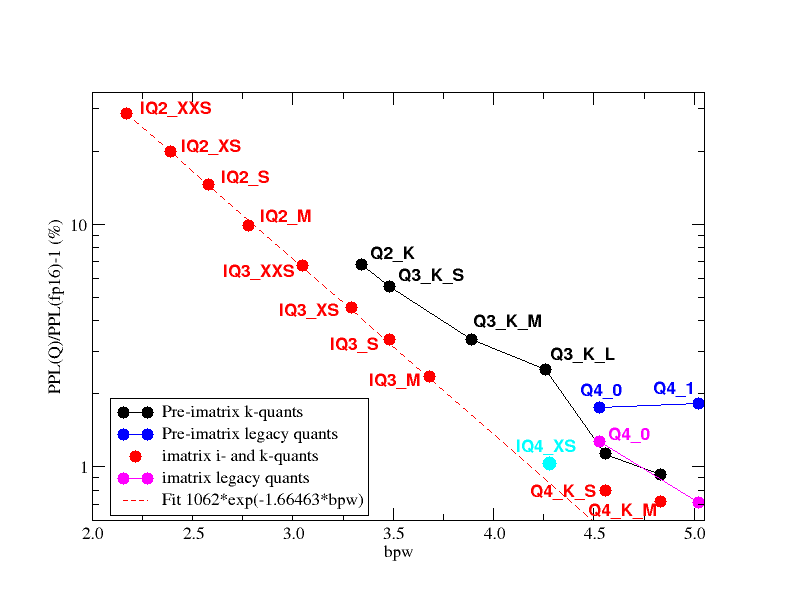

Всем известно, что надо ставить 6 кванты, но их почему-то нет здесь. Ниудобные цифры получились бы. Ну а так, очередная статья для дроча харша + попытка протолкнуть свои кванты.

# Импортирование необходимых библиотек

import os.path

import pandas as pd

import numpy as np

import tensorflow as tf

from binance.client import Client

# Получение доступа к API биржи бинанс

api_key = 'Ключ'

api_secret = 'Секрет'

client = Client(api_key, api_secret)

# Сбор данных о криптовалютах и их изменении цен за определенный период времени

if os.path.exists("data.csv"):

bars = pd.read_csv("data.csv")

else:

data_file = open("data.csv", "w+")

data_file.close()

df = pd.DataFrame(client.get_historical_klines("BTCUSDT", Client.KLINE_INTERVAL_5MINUTE, "90 days ago UTC"))

df.to_csv("data.csv", index=False)

bars = pd.read_csv("data.csv")

#bars = client.get_historical_klines("BTCUSDT", Client.KLINE_INTERVAL_5MINUTE, "180 days ago UTC")

# Подготовка данных для обучения нейросети

data = pd.DataFrame(bars,

columns=['timestamp', 'open', 'high', 'low', 'close', 'volume', 'close_time', 'quote_asset_volume',

'number_of_trades', 'taker_buy_base_asset_volume', 'taker_buy_quote_asset_volume',

'ignore'])

data.drop(columns=['close_time', 'quote_asset_volume', 'number_of_trades', 'taker_buy_base_asset_volume', 'taker_buy_quote_asset_volume', 'ignore'], inplace=True)

data['timestamp'] = pd.to_datetime(data['timestamp'], unit='ms')

data.set_index('timestamp', inplace=True)

data = data.astype(float)

# Создание модели нейросети

model = tf.keras.Sequential([

tf.keras.layers.Dense(128, activation='relu', input_shape=(5,)),

tf.keras.layers.BatchNormalization(),

tf.keras.layers.Dense(64, activation='relu'),

tf.keras.layers.Dense(32, activation='relu'),

tf.keras.layers.Dense(1)

])

MyOpt = tf.keras.optimizers.SGD(learning_rate=0.05, momentum=0.05, nesterov=True)

# Компиляция модели

model.compile(optimizer=MyOpt,

loss='mape',

metrics='accuracy')

# Обучение модели на подготовленных данных

model.fit(data.iloc[:-100], data['close'].iloc[:-100], batch_size=15, epochs=400, validation_split=0.2)

# Проверка качества работы нейросети на тестовых данных

model.evaluate(data.iloc[-100:], data['close'].iloc[-100:])

# Использование нейросети для принятия решений о покупке или продаже криптовалют на бирже бинанс

prediction = model.predict(data.iloc[-1:].values)

if prediction > data['close'].iloc[-1]:

print('Купить')

else:

print('Продать')

Проблема заключается в процессе обучения, во первых, если выдёргивать данные из файла (Если я всё правильно написал), то процесс обучения заходит в тупик и loss улетает, поэтому выдаётся nan, почему так происходит я не понимаю, пробовал разные методы и параметры оптимизации и разные функции потерь. Есть мысль что как то неправильно берутся данные из файла, так как если расскоментить bars = client.get_historical_klines("BTCUSDT", Client.KLINE_INTERVAL_5MINUTE, "180 days ago UTC") То процесс обучения начинает хоть как то идти. Во вторых параметр метрики, в частности точность тут не подходит, я так понимаю, надо написать свой метод для определения точности. Активационную функцию выбрал для всех слоев relu, так как при при других опять же процесс обучения просто упадёт. Пробовал с разным кол-вом нейронов, выход один и тот же, максимум чего удалось добиться это loss = 1000 (Чего немного дофига)

Нижнюю часть, в частности проверка качества работы и использование нейронки можно пока выбросить.

Есть у кого идеи по размеру батчей, возможно мало эпох или ещё чего то не хватает. С переобучением не сталкивался, так что dropout и нормализацию батчей не использовал.

Надеюсь ты еще тут появляешься, ОП.

Стало интересно, и я посмотрел в сторону ByBit, там тоже есть API, есть либа для питона, но вот когда получаешь инфу о свечах - параметров меньше чем у бинанса, не могу пока понять, насколько это критично.

А нет именно

quote_asset_volume

number_of_trades

'taker_buy_base_asset_volume

taker_buy_quote_asset_volume

Но есть Turnover (Unit of figure: quantity of quota coin)

Я подумал, что может быть еще стоит Open Interest так же добавить в данные для обучения.

И вообще, как идут/шли дела? На чем остановился?

это работать не будет, не трать в пустую время

Сбер: https://fusionbrain.ai/diffusion

GPT от них же: https://sbercloud.ru/ru/datahub/rugpt3family/demo-ru-gpt3-xl

Бинг: https://bing.com/create

Яндекс: https://yandex.ru/lab/yalm

Problembo: https://problembo.com/services/ai-image-generator

Midjourney: пока тонет в своем личном треде >>8401 (OP)

Продолжаем список.

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

Общий вопросов по чат-ботам и прочего тред.

- Фронтэнды -

Agnai, SillyTavern, RisuAI

Гайды: https://rentry.co/ultimatespoonfeed | https://rentry.co/Tavern4Retards (Гайд на английском) | https://rentry.org/STAI-Termux (На андроид)

Базовые термины: https://2ch-ai.gitgud.site/wiki/llama/

Скрипты SillyTavern (Quick Replies): https://rentry.org/stscript

https://github.com/SillyTavern/SillyTavern | https://github.com/ntvm/SillyTavern (Форк нв-куна)

https://agnai.chat/

https://risuai.xyz/

- GPT -

Джейлы на 0314/0613: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/fa5fv | https://dumb.one/gpt/prompts-scraped/ | https://rentry.co/lobstersgpt

Джейлы на 1106: https://rentry.co/anonaugusproductionsCustomJB | https://rentry.co/crustcrunchGPT | https://rentry.co/Myuu_Jippy | https://rentry.co/CoTonAugus | https://rentry.org/onichan2210

Джейлы на 0125: https://rentry.org/neo-furbo | https://rentry.org/camicle-jb

Джейлы на Turbo: https://rentry.co/YAnonTurbo | https://rentry.co/hochi-reupload

- Claude -

Джейлы: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/absolutejail | https://rentry.co/pitanonbots#prompt-presets | https://rentry.co/XML-dva-shiza | https://rentry.co/crustcrunchJB | https://rentry.co/CharacterProvider | https://rentry.co/MyuuTastic

Опус/Соннет: https://rentry.org/Anon4Anon | https://unconvincing.neocities.org/ | https://rentry.org/pancatb3ta | https://rentry.org/AiBrainPresets | https://rentry.org/CladeOpus-GigaSchizoKostyl

Удаление Human/Assistant: https://rentry.co/TavernNoAss | https://rentry.co/HumAssistOff

Префилл: https://rentry.co/aui3u

Полезное: https://rentry.org/anonika_infoblock | https://rentry.org/zapominator

- Мемо -

Мемо вручную: https://rentry.co/DrunkArcadeExample

Генератор мемо: https://rentry.co/LazyMemo

Мемо на опусе: https://rentry.co/HornyPigs

- Bing -

https://github.com/Barbariskaa/Biba

Гайд: https://rentry.co/BingZOVEdition

- Локалки -

https://openrouter.ai/

Гайд (на английском): https://rentry.co/meta_golocal_list

- Ботоводчество -

https://www.chub.ai

https://booru.plus/+pygmalion

https://des une.moe/aichared/

https://agnai.chat/editor

https://rentry.co/botmaking_tips

https://rentry.co/MothsBotMakingStuff

https://rentry.co/oaicards

Боты анонов: https://rentry.co/2chaicgtavernbots | https://rentry.co/2chaicgtavernbots2

- Село 2ch -

https://rentry.co/selo2ch

- Архив тредов -

https://rentry.co/2ch-aicg-archives

- GIGACHAT -

https://rentry.co/3bc7r

- Character.AI -

https://beta.character.ai/

https://rentry.co/CAI-FAQ

Боты анонов: https://rentry.co/CAI-bots

- Прочее -

Проверить ключ:

GPT

https://github.com/Buhankoanon/OAI_API_Checker | https://github.com/CncAnon1/kkc

Claude

https://github.com/Definetelynotbranon/Anthropic_API_Checker

Специфические промпты в джейл для кума: https://rentry.co/jinxbreaks

Забавные промпты после кума: https://rentry.co/weirdbutfunjailbreaksandprompts

- Конкурсы -

Общая информация: https://rentry.co/2chaicgthemedevents

Текущий конкурс: >>713069 →

- Шапка -

https://rentry.co/shapkacaitreda

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

- Локальные языковые модели: >>661076 (OP) -

- Прошлый тред:>>712163 (OP) -

Здесь мы делимся рецептами запуска, настроек и годных промтов, расширяем сознание контекст, и бугуртим с кривейшего тормозного говна.

Тред для обладателей топовых карт NVidia с кучей VRAM или мажоров с проф картами уровня A100, или любителей подождать, если есть оперативная память. Особо терпеливые могут использовать даже подкачку и запускать модели, квантованные до 8 5 4 3 2 0,58 бит, на кофеварке с подкачкой на микроволновку.

Здесь и далее расположена базовая информация, полная инфа и гайды в вики https://2ch-ai.gitgud.site/wiki/llama/

LLaMA 3 вышла! Увы, только в размерах 8B и 70B. В треде можно поискать ссылки на правленные промт форматы, дефолтные не подходят. Ждём исправлений.

Базовой единицей обработки любой языковой модели является токен. Токен это минимальная единица, на которые разбивается текст перед подачей его в модель, обычно это слово (если популярное), часть слова, в худшем случае это буква (а то и вовсе байт).

Из последовательности токенов строится контекст модели. Контекст это всё, что подаётся на вход, плюс резервирование для выхода. Типичным максимальным размером контекста сейчас являются 2к (2 тысячи) и 4к токенов, но есть и исключения. В этот объём нужно уместить описание персонажа, мира, истории чата. Для расширения контекста сейчас применяется метод NTK-Aware Scaled RoPE. Родной размер контекста для Llama 1 составляет 2к токенов, для Llama 2 это 4к, Llama 3 обладает базовым контекстом в 8к, но при помощи RoPE этот контекст увеличивается в 2-4-8 раз без существенной потери качества.

Базовым языком для языковых моделей является английский. Он в приоритете для общения, на нём проводятся все тесты и оценки качества. Большинство моделей хорошо понимают русский на входе т.к. в их датасетах присутствуют разные языки, в том числе и русский. Но их ответы на других языках будут низкого качества и могут содержать ошибки из-за несбалансированности датасета. Существуют мультиязычные модели частично или полностью лишенные этого недостатка, из легковесных это openchat-3.5-0106, который может давать качественные ответы на русском и рекомендуется для этого. Из тяжёлых это Command-R. Файнтюны семейства "Сайга" не рекомендуются в виду их низкого качества и ошибок при обучении.

Основным представителем локальных моделей является LLaMA. LLaMA это генеративные текстовые модели размерами от 7B до 70B, притом младшие версии моделей превосходят во многих тестах GTP3 (по утверждению самого фейсбука), в которой 175B параметров. Сейчас на нее существует множество файнтюнов, например Vicuna/Stable Beluga/Airoboros/WizardLM/Chronos/(любые другие) как под выполнение инструкций в стиле ChatGPT, так и под РП/сторитейл. Для получения хорошего результата нужно использовать подходящий формат промта, иначе на выходе будут мусорные теги. Некоторые модели могут быть излишне соевыми, включая Chat версии оригинальной Llama 2.

Про остальные семейства моделей читайте в вики.

Основные форматы хранения весов это GGML и GPTQ, остальные нейрокуну не нужны. Оптимальным по соотношению размер/качество является 5 бит, по размеру брать максимальную, что помещается в память (видео или оперативную), для быстрого прикидывания расхода можно взять размер модели и прибавить по гигабайту за каждые 1к контекста, то есть для 7B модели GGML весом в 4.7ГБ и контекста в 2к нужно ~7ГБ оперативной.

В общем и целом для 7B хватает видеокарт с 8ГБ, для 13B нужно минимум 12ГБ, для 30B потребуется 24ГБ, а с 65-70B не справится ни одна бытовая карта в одиночку, нужно 2 по 3090/4090.

Даже если использовать сборки для процессоров, то всё равно лучше попробовать задействовать видеокарту, хотя бы для обработки промта (Use CuBLAS или ClBLAS в настройках пресетов кобольда), а если осталась свободная VRAM, то можно выгрузить несколько слоёв нейронной сети на видеокарту. Число слоёв для выгрузки нужно подбирать индивидуально, в зависимости от объёма свободной памяти. Смотри не переборщи, Анон! Если выгрузить слишком много, то начиная с 535 версии драйвера NVidia это может серьёзно замедлить работу, если не выключить CUDA System Fallback в настройках панели NVidia. Лучше оставить запас.

Гайд для ретардов для запуска LLaMA без излишней ебли под Windows. Грузит всё в процессор, поэтому ёба карта не нужна, запаситесь оперативкой и подкачкой:

1. Скачиваем koboldcpp.exe https://github.com/LostRuins/koboldcpp/releases/ последней версии.

2. Скачиваем модель в gguf формате. Например вот эту:

https://huggingface.co/Sao10K/Fimbulvetr-10.7B-v1-GGUF/blob/main/Fimbulvetr-10.7B-v1.q5_K_M.gguf

Можно просто вбить в huggingace в поиске "gguf" и скачать любую, охуеть, да? Главное, скачай файл с расширением .gguf, а не какой-нибудь .pt

3. Запускаем koboldcpp.exe и выбираем скачанную модель.

4. Заходим в браузере на http://localhost:5001/

5. Все, общаемся с ИИ, читаем охуительные истории или отправляемся в Adventure.

Да, просто запускаем, выбираем файл и открываем адрес в браузере, даже ваша бабка разберется!

Для удобства можно использовать интерфейс TavernAI

1. Ставим по инструкции, пока не запустится: https://github.com/Cohee1207/SillyTavern

2. Запускаем всё добро

3. Ставим в настройках KoboldAI везде, и адрес сервера http://127.0.0.1:5001

4. Активируем Instruct Mode и выставляем в настройках пресетов Alpaca

5. Радуемся

Инструменты для запуска:

https://github.com/LostRuins/koboldcpp/ Репозиторий с реализацией на плюсах

https://github.com/oobabooga/text-generation-webui/ ВебуУИ в стиле Stable Diffusion, поддерживает кучу бекендов и фронтендов, в том числе может связать фронтенд в виде Таверны и бекенды ExLlama/llama.cpp/AutoGPTQ

https://github.com/ollama/ollama Однокнопочный инструмент для полных хлебушков в псевдо стиле Apple (никаких настроек, автор знает лучше)

Ссылки на модели и гайды:

https://huggingface.co/models Модели искать тут, вбиваем название + тип квантования

https://rentry.co/TESFT-LLaMa Не самые свежие гайды на ангельском

https://rentry.co/STAI-Termux Запуск SillyTavern на телефоне

https://rentry.co/lmg_models Самый полный список годных моделей

http://ayumi.m8geil.de/ayumi_bench_v3_results.html Рейтинг моделей для кума со спорной методикой тестирования

https://rentry.co/llm-training Гайд по обучению своей лоры

https://rentry.co/2ch-pygma-thread Шапка треда PygmalionAI, можно найти много интересного

https://colab.research.google.com/drive/11U-bC6AxdmMhd3PF9vWZpLdi6LdfnBQ8?usp=sharing Последний известный колаб для обладателей отсутствия любых возможностей запустить локально

Шапка в https://rentry.co/llama-2ch, предложения принимаются в треде

Предыдущие треды тонут здесь:

>>709757 (OP)

>>704905 (OP)

>>714891

по ощущениям ллама-3 догнала проприетарщину по соевости, также стало сложнее обходить это, по настоящему стрёмно за файнтюны, не думаю что они исправят это.

Паровоз локалок продолжает нестись, надеюсь не под откос.

>>714898 (OP)

>>714898 (OP)

♫ Udio ♫

https://www.udio.com/

Лимиты: 1200 генераций в месяц

♫ Suno ♫

https://app.suno.ai/ генерация на сайте

https://suno.ai/discord генерация на официальном discord-сервере

https://rentry.co/suno_tips советы по использованию

Лимиты: 5 генераций в день. Нужна платная подписка чтобы увеличить лимиты, либо можно абузить сервис через создание множества аккаунтов

♫ Локальные модели ♫

Ждём и надеемся...

🎙️ Открытый бета-тест Udio

В открытую бету вышла нейросеть Udio, которая, по словам множества пользователей, превосходит Suno V3 в генерации музыкальных композиций. Пока идёт бета-тест, доступно 1200 генераций в месяц с одного аккаунта.

Udio и Suno поддерживают множество языков для вокала (включая русский) и большое разнообразие жанров.

Ориджинал контент крайне приветствуется.

Прошлый тред: >>662527 (OP)

Если не нравится, то долбите тогда модера.

>>718382 (OP)

>>718382 (OP)

>>718382 (OP)

>>718382 (OP)

>>718382 (OP)

>>718382 (OP)

======================================

Предыдущий тред >>701338 (OP) https://arhivac.top/?tags=13840

------------------------------------------

схожие тематические треды

- NAI-тред (аниме) >>698708 (OP)

- технотред >>639060 (OP)

========================

Stable Diffusion (SD) - открытая нейросеть генеративного искусства для создания картинок из текста/исходных картинок, обучения на своих изображениях.

Полный функционал в локальной установке (см. ниже)

Альтернативный онлайн-генератор №1: https://dezgo.com/txt2img

Альтернативный онлайн-генератор №2: https://civitai.com/ (create после регистрации)

Альтернативный онлайн-генератор №3: https://tensor.art/ (Workspace)

⚠️ Стандартные модели stable diffusion от Stability AI значительно отстают по качеству от кастомных моделей (см. civitai ниже).

🔞 Без цензуры и полный функци_анал: только ПК-версия

===========================================

🖥УСТАНОВКА НА ПК

WebUI от Automatic1111

https://teletype.in/@stablediffusion/PC_install_SD

------------------------------------------

Forge - Почти тот же WebUI, что и выше, но более быстрый по скорости

https://github.com/lllyasviel/stable-diffusion-webui-forge

------------------------------------------

👉 Для новичков - простой в работе WebUI Fooocus

https://github.com/lllyasviel/Fooocus?tab=readme-ov-file#download

------------------------------------------

Портативная версия альтернативного WebUI от Comfy (запуск с одного из run.bat файлов)

https://github.com/comfyanonymous/ComfyUI/releases

Примерные workflow для ComfyUI (можно загружать напрямую из картинок)

https://comfyanonymous.github.io/ComfyUI_examples/

===========================================

📚 РАЗЛИЧНЫЕ МОДЕЛИ (И МНОГОЕ ДРУГОЕ) 👇

https://civitai.com/

------------------------------------------

📊 ПАРАМЕТРЫ И НАСТРОЙКИ ГЕНЕРАЦИИ 👇

https://teletype.in/@stablediffusion/samplers_steps

===========================================

🎨 ГАЙД ПО СОСТАВЛЕНИЮ ЗАПРОСА, СТИЛИ

https://teletype.in/@stablediffusion/artists_for_prompts

Пример запроса (Промпт): a tiger, wildlife photography, high quality, wildlife, soft focus, 8k, national geographic, photograph by nick nichols

------------------------------------------

♾️РАЗЛИЧНЫЕ ХУДОЖЕСТВЕННЫЕ СТИЛИ (С ПРИМЕРАМИ) 👇

https://supagruen.github.io/StableDiffusion-CheatSheet/

https://www.artvy.ai/styles

------------------------------------------

💻ЧТО ТАКОЕ CONTROLNET И КАК ЕГО ИСПОЛЬЗОВАТЬ

https://www.itshneg.com/controlnt-upravlyaj-pozami-v-stable-diffusion/

==========================================

🧠 ОБУЧЕНИЕ ПО СВОИМ КАРТИНКАМ 👇

https://dtf.ru/howto/1660668-obuchenie-modeli-s-pomoshchyu-lora

https://civitai.com/models/train

>>714946 (OP)

>>714946 (OP)

>>714946 (OP)

ПЕРЕКАТ

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

Общий вопросов по чат-ботам и прочего тред.

- Фронтэнды -

Agnai, SillyTavern, RisuAI

Гайды: https://rentry.co/ultimatespoonfeed | https://rentry.co/Tavern4Retards (Гайд на английском) | https://rentry.org/STAI-Termux (На андроид)

Базовые термины: https://2ch-ai.gitgud.site/wiki/llama/

Скрипты SillyTavern (Quick Replies): https://rentry.org/stscript

https://github.com/SillyTavern/SillyTavern | https://github.com/ntvm/SillyTavern (Форк нв-куна)

https://agnai.chat/

https://risuai.xyz/

- GPT -

Джейлы на 0314/0613: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/fa5fv | https://dumb.one/gpt/prompts-scraped/ | https://rentry.co/lobstersgpt

Джейлы на 1106: https://rentry.co/anonaugusproductionsCustomJB | https://rentry.co/crustcrunchGPT | https://rentry.co/Myuu_Jippy | https://rentry.co/CoTonAugus | https://rentry.org/onichan2210

Джейлы на 0125: https://rentry.org/neo-furbo | https://rentry.org/camicle-jb

Джейлы на Turbo: https://rentry.co/YAnonTurbo | https://rentry.co/hochi-reupload

- Claude -

Джейлы: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/absolutejail | https://rentry.co/pitanonbots#prompt-presets | https://rentry.co/XML-dva-shiza | https://rentry.co/crustcrunchJB | https://rentry.co/CharacterProvider | https://rentry.co/MyuuTastic

Опус/Соннет: https://rentry.org/Anon4Anon | https://unconvincing.neocities.org/ | https://rentry.org/pancatb3ta | https://rentry.org/AiBrainPresets | https://rentry.org/CladeOpus-GigaSchizoKostyl

Удаление Human/Assistant: https://rentry.co/TavernNoAss | https://rentry.co/HumAssistOff

Префилл: https://rentry.co/aui3u

Полезное: https://rentry.org/anonika_infoblock | https://rentry.org/zapominator

- Мемо -

Мемо вручную: https://rentry.co/DrunkArcadeExample

Генератор мемо: https://rentry.co/LazyMemo

Мемо на опусе: https://rentry.co/HornyPigs

- Bing -

https://github.com/Barbariskaa/Biba

Гайд: https://rentry.co/BingZOVEdition

- Локалки -

https://openrouter.ai/

Гайд (на английском): https://rentry.co/meta_golocal_list

- Ботоводчество -

https://www.chub.ai

https://booru.plus/+pygmalion

https://des une.moe/aichared/

https://agnai.chat/editor

https://rentry.co/botmaking_tips

https://rentry.co/MothsBotMakingStuff

https://rentry.co/oaicards

Боты анонов: https://rentry.co/2chaicgtavernbots | https://rentry.co/2chaicgtavernbots2

- Село 2ch -

https://rentry.co/selo2ch

- Архив тредов -

https://rentry.co/2ch-aicg-archives

- GIGACHAT -

https://rentry.co/3bc7r

- Character.AI -

https://beta.character.ai/

https://rentry.co/CAI-FAQ

Боты анонов: https://rentry.co/CAI-bots

- Прочее -

Проверить ключ:

GPT

https://github.com/Buhankoanon/OAI_API_Checker | https://github.com/CncAnon1/kkc

Claude

https://github.com/Definetelynotbranon/Anthropic_API_Checker

Специфические промпты в джейл для кума: https://rentry.co/jinxbreaks

Забавные промпты после кума: https://rentry.co/weirdbutfunjailbreaksandprompts

- Конкурсы -

Общая информация: https://rentry.co/2chaicgthemedevents

Текущий конкурс: >>710144 →

- Шапка -

https://rentry.co/shapkacaitreda

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

- Локальные языковые модели: >>712072 (OP) -

- Прошлый тред: >>709270 (OP) -

>>715057

у мя такого нет но вдруг поможет:

https://github.com/nodejs/node/issues/52582

А где это раздобыть? Я просто кроме krea и пары нейросеток больше ничего не знаю. Мне просто нужна нейросетка где можно обрабатывать фотографии в приемлемом качестве и с минимум ограничений.

Krea в этом плане хорошо подходила пока этот залупный баг не вылез который я хз как обойти. На всяких рэддитах при быстром поиске ничего не нашел по такой проблеме

Можно стейблдифужен с быстрым семплером пробросить в фотошоп или криту. Для криты вроде даже реалтайм рисовка имеется. Возможно можно плейграунд 2.5 через комфи с модулями на рисование также сделать, но я не гуглил. У тебя вопрос стоит только в наличии видеокарты.

Здесь мы делимся рецептами запуска, настроек и годных промтов, расширяем сознание контекст, и бугуртим с кривейшего тормозного говна.

Тред для обладателей топовых карт NVidia с кучей VRAM или мажоров с проф картами уровня A100, или любителей подождать, если есть оперативная память. Особо терпеливые могут использовать даже подкачку и запускать модели, квантованные до 8 5 4 3 2 0,58 бит, на кофеварке с подкачкой на микроволновку.

Здесь и далее расположена базовая информация, полная инфа и гайды в вики https://2ch-ai.gitgud.site/wiki/llama/

LLaMA 3 вышла! Впрочем всем похуй, всё одно говно без размеров и с соей, размером только 8B и 70B.

Базовой единицей обработки любой языковой модели является токен. Токен это минимальная единица, на которые разбивается текст перед подачей его в модель, обычно это слово (если популярное), часть слова, в худшем случае это буква (а то и вовсе байт).

Из последовательности токенов строится контекст модели. Контекст это всё, что подаётся на вход, плюс резервирование для выхода. Типичным максимальным размером контекста сейчас являются 2к (2 тысячи) и 4к токенов, но есть и исключения. В этот объём нужно уместить описание персонажа, мира, истории чата. Для расширения контекста сейчас применяется метод NTK-Aware Scaled RoPE. Родной размер контекста для Llama 1 составляет 2к токенов, для Llama 2 это 4к, но при помощи RoPE этот контекст увеличивается в 2-4-8 раз без существенной потери качества.

Базовым языком для языковых моделей является английский. Он в приоритете для общения, на нём проводятся все тесты и оценки качества. Большинство моделей хорошо понимают русский на входе т.к. в их датасетах присутствуют разные языки, в том числе и русский. Но их ответы на других языках будут низкого качества и могут содержать ошибки из-за несбалансированности датасета. Существуют мультиязычные модели частично или полностью лишенные этого недостатка, из легковесных это openchat-3.5-0106, который может давать качественные ответы на русском и рекомендуется для этого. Из тяжёлых это Command-R. Файнтюны семейства "Сайга" не рекомендуются в виду их низкого качества и ошибок при обучении.

Основным представителем локальных моделей является LLaMA. LLaMA это генеративные текстовые модели размерами от 7B до 70B, притом младшие версии моделей превосходят во многих тестах GTP3 (по утверждению самого фейсбука), в которой 175B параметров. Сейчас на нее существует множество файнтюнов, например Vicuna/Stable Beluga/Airoboros/WizardLM/Chronos/(любые другие) как под выполнение инструкций в стиле ChatGPT, так и под РП/сторитейл. Для получения хорошего результата нужно использовать подходящий формат промта, иначе на выходе будут мусорные теги. Некоторые модели могут быть излишне соевыми, включая Chat версии оригинальной Llama 2.

Про остальные семейства моделей читайте в вики.

Основные форматы хранения весов это GGML и GPTQ, остальные нейрокуну не нужны. Оптимальным по соотношению размер/качество является 5 бит, по размеру брать максимальную, что помещается в память (видео или оперативную), для быстрого прикидывания расхода можно взять размер модели и прибавить по гигабайту за каждые 1к контекста, то есть для 7B модели GGML весом в 4.7ГБ и контекста в 2к нужно ~7ГБ оперативной.

В общем и целом для 7B хватает видеокарт с 8ГБ, для 13B нужно минимум 12ГБ, для 30B потребуется 24ГБ, а с 65-70B не справится ни одна бытовая карта в одиночку, нужно 2 по 3090/4090.

Даже если использовать сборки для процессоров, то всё равно лучше попробовать задействовать видеокарту, хотя бы для обработки промта (Use CuBLAS или ClBLAS в настройках пресетов кобольда), а если осталась свободная VRAM, то можно выгрузить несколько слоёв нейронной сети на видеокарту. Число слоёв для выгрузки нужно подбирать индивидуально, в зависимости от объёма свободной памяти. Смотри не переборщи, Анон! Если выгрузить слишком много, то начиная с 535 версии драйвера NVidia это может серьёзно замедлить работу, если не выключить CUDA System Fallback в настройках панели NVidia. Лучше оставить запас.

Гайд для ретардов для запуска LLaMA без излишней ебли под Windows. Грузит всё в процессор, поэтому ёба карта не нужна, запаситесь оперативкой и подкачкой:

1. Скачиваем koboldcpp.exe https://github.com/LostRuins/koboldcpp/releases/ последней версии.

2. Скачиваем модель в gguf формате. Например вот эту:

https://huggingface.co/Sao10K/Fimbulvetr-10.7B-v1-GGUF/blob/main/Fimbulvetr-10.7B-v1.q5_K_M.gguf

Можно просто вбить в huggingace в поиске "gguf" и скачать любую, охуеть, да? Главное, скачай файл с расширением .gguf, а не какой-нибудь .pt

3. Запускаем koboldcpp.exe и выбираем скачанную модель.

4. Заходим в браузере на http://localhost:5001/

5. Все, общаемся с ИИ, читаем охуительные истории или отправляемся в Adventure.

Да, просто запускаем, выбираем файл и открываем адрес в браузере, даже ваша бабка разберется!

Для удобства можно использовать интерфейс TavernAI

1. Ставим по инструкции, пока не запустится: https://github.com/Cohee1207/SillyTavern

2. Запускаем всё добро

3. Ставим в настройках KoboldAI везде, и адрес сервера http://127.0.0.1:5001

4. Активируем Instruct Mode и выставляем в настройках пресетов Alpaca

5. Радуемся

Инструменты для запуска:

https://github.com/LostRuins/koboldcpp/ Репозиторий с реализацией на плюсах

https://github.com/oobabooga/text-generation-webui/ ВебуУИ в стиле Stable Diffusion, поддерживает кучу бекендов и фронтендов, в том числе может связать фронтенд в виде Таверны и бекенды ExLlama/llama.cpp/AutoGPTQ

Ссылки на модели и гайды:

https://huggingface.co/models Модели искать тут, вбиваем название + тип квантования

https://rentry.co/TESFT-LLaMa Не самые свежие гайды на ангельском

https://rentry.co/STAI-Termux Запуск SillyTavern на телефоне

https://rentry.co/lmg_models Самый полный список годных моделей

http://ayumi.m8geil.de/ayumi_bench_v3_results.html Рейтинг моделей для кума со спорной методикой тестирования

https://rentry.co/llm-training Гайд по обучению своей лоры

https://rentry.co/2ch-pygma-thread Шапка треда PygmalionAI, можно найти много интересного

https://colab.research.google.com/drive/11U-bC6AxdmMhd3PF9vWZpLdi6LdfnBQ8?usp=sharing Последний известный колаб для обладателей отсутствия любых возможностей запустить локально

Шапка в https://rentry.co/llama-2ch, предложения принимаются в треде

Предыдущие треды тонут здесь:

>>704905 (OP)

>>699623 (OP)

Совсем ебанулись, чуть больше 2-х дней ушло.

>>712072 (OP)

>>712072 (OP)

убабуба это ад зависимостей с питоном, ничего удивительного.

критерии:

1) бесплатно и безлимитно (без кредитов, премиума, энергии и т.д.)

2) генерация SFW/NSFW изображений по ходу "сюжета"

3) можно нагенерить крутых историй прямо в диалоге

пример:

www.gptgirlfriend.online / Knight Astoria

начал интересную историю и тут "ПЛОТИ ИЛИ ПНХ"

попробовал KoboldAI (рандомно тыкал, насколько освоился в настройках и моделях, английский знаю очень хорошо)

местами неплохо, но все же часто выдает околесицу и никакой "погружающей" истории не выходит. У меня оно часто путает персонажей или вообще несет полный бред, хотя старался вникнуть в модели, режимы и настройки. Поиски продолжаются

Если у кого вышло запустить кобольда в таком режиме как в ОП, прошу, объясните пошагово, какие надо выставлять модели, настройки, модули, скрипты и т.д., поскольку я в этому полный нуб

Локально - требуется железо, знания, пердолинг >>709757 (OP)

В облаках - требуется хотябы навык следования гайдам и найти себе к ним доступ >>709270 (OP)

Про генерацию изображений по ходу спросишь в тех тредах

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

Общий вопросов по чат-ботам и прочего тред.

- Фронтэнды -

Agnai, SillyTavern, RisuAI

Гайды: https://rentry.co/ultimatespoonfeed | https://rentry.co/Tavern4Retards (Гайд на английском) | https://rentry.org/STAI-Termux (На андроид)

Базовые термины: https://2ch-ai.gitgud.site/wiki/llama/

Скрипты SillyTavern (Quick Replies): https://rentry.org/stscript

https://github.com/SillyTavern/SillyTavern | https://github.com/ntvm/SillyTavern (Форк нв-куна)

https://agnai.chat/

https://risuai.xyz/

- GPT -

Джейлы на 0314/0613: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/fa5fv | https://dumb.one/gpt/prompts-scraped/ | https://rentry.co/lobstersgpt

Джейлы на 1106: https://rentry.co/anonaugusproductionsCustomJB | https://rentry.co/crustcrunchGPT | https://rentry.co/Myuu_Jippy | https://rentry.co/CoTonAugus | https://rentry.org/onichan2210

Джейлы на 0125: https://rentry.org/neo-furbo | https://rentry.org/camicle-jb

Джейлы на Turbo: https://rentry.co/YAnonTurbo | https://rentry.co/hochi-reupload

- Claude -

Джейлы: https://rentry.co/SillyTavern_JB_Pack | https://rentry.co/absolutejail | https://rentry.co/pitanonbots#prompt-presets | https://rentry.co/XML-dva-shiza | https://rentry.co/crustcrunchJB | https://rentry.co/CharacterProvider | https://rentry.co/MyuuTastic

Опус/Соннет: https://rentry.org/Anon4Anon | https://unconvincing.neocities.org/ | https://rentry.org/pancatb3ta | https://rentry.org/AiBrainPresets | https://rentry.org/CladeOpus-GigaSchizoKostyl

Удаление Human/Assistant: https://rentry.co/TavernNoAss | https://rentry.co/HumAssistOff

Префилл: https://rentry.co/aui3u

Полезное: https://rentry.org/anonika_infoblock | https://rentry.org/zapominator

- Мемо -

Мемо вручную: https://rentry.co/DrunkArcadeExample

Генератор мемо: https://rentry.co/LazyMemo

Мемо на опусе: https://rentry.co/HornyPigs

- Bing -

https://github.com/Barbariskaa/Biba

Гайд: https://rentry.co/BingZOVEdition

- Локалки -

https://openrouter.ai/

Гайд (на английском): https://rentry.co/meta_golocal_list

- Ботоводчество -

https://www.chub.ai

https://booru.plus/+pygmalion

https://des une.moe/aichared/

https://agnai.chat/editor

https://rentry.co/botmaking_tips

https://rentry.co/MothsBotMakingStuff

https://rentry.co/oaicards

Боты анонов: https://rentry.co/2chaicgtavernbots | https://rentry.co/2chaicgtavernbots2

- Село 2ch -

https://rentry.co/selo2ch

- Архив тредов -

https://rentry.co/2ch-aicg-archives

- GIGACHAT -

https://rentry.co/3bc7r

- Character.AI -

https://beta.character.ai/

https://rentry.co/CAI-FAQ

Боты анонов: https://rentry.co/CAI-bots

- Прочее -

Проверить ключ:

GPT

https://github.com/Buhankoanon/OAI_API_Checker | https://github.com/CncAnon1/kkc

Claude

https://github.com/Definetelynotbranon/Anthropic_API_Checker

Специфические промпты в джейл для кума: https://rentry.co/jinxbreaks

Забавные промпты после кума: https://rentry.co/weirdbutfunjailbreaksandprompts

- Конкурсы -

Общая информация: https://rentry.co/2chaicgthemedevents

Текущий конкурс: >>705243 →

- Шапка -

https://rentry.co/shapkacaitreda

БОТОДЕЛЫ!!!! Прикрепляйте новых ботов к оп-посту!!!!

- Локальные языковые модели: >>661076 (OP) -

- Прошлый тред: >>706721 (OP) -